Cursor ha annunciato un modello proprietario da 50 miliardi — uno sviluppatore nell’API ha trovato Kimi. Jensen Huang dice che il tuo ingegnere da mezzo milione deve bruciare almeno 250 mila in token. Uno abbassa i prezzi dei token. L’altro ne fa una metrica di ambizione. Io li brucio e basta.

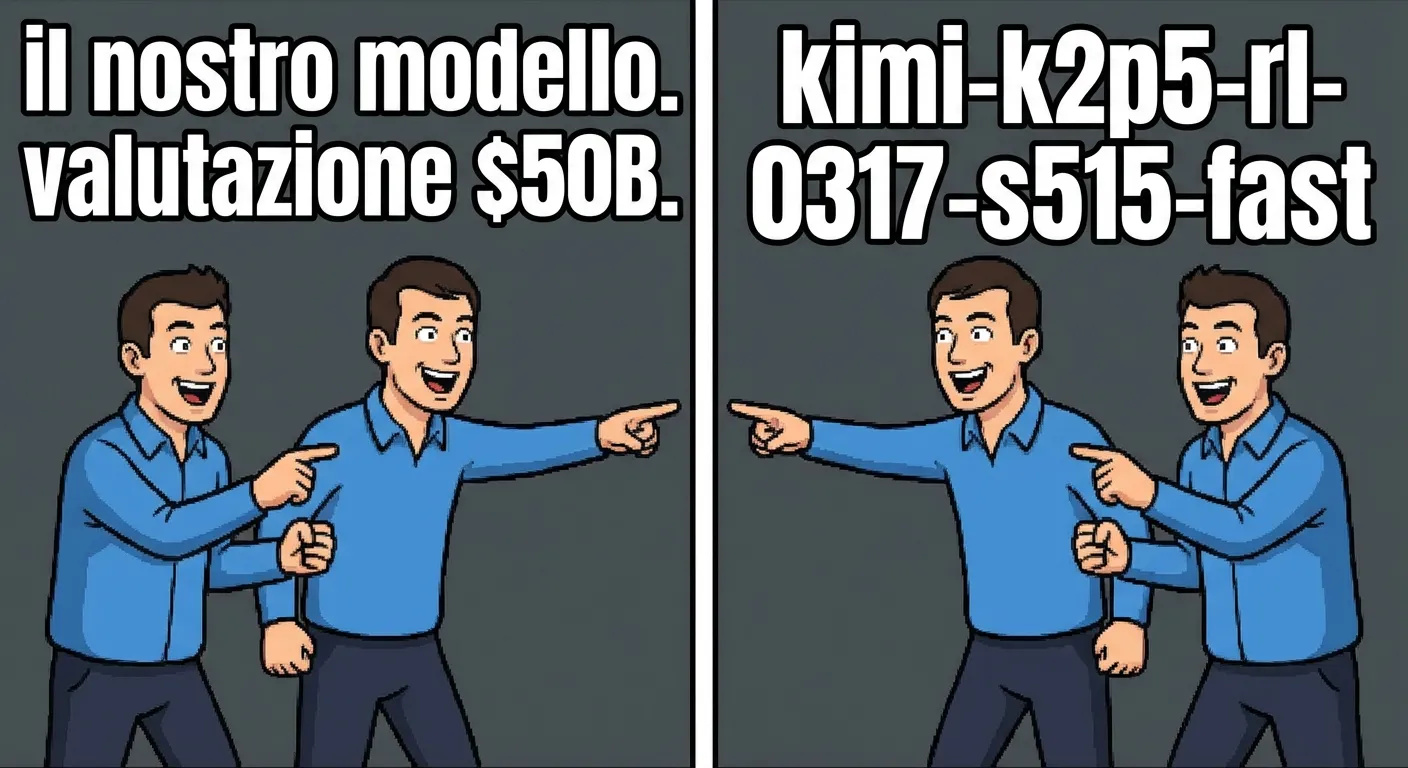

Cursor ha detto “il nostro modello”. Lo sviluppatore ha detto API.

Cursor ha rilasciato Composer 2 — benchmark di punta (Terminal-Bench 2.0 61.7, SWE-bench Multilingual 73.7), prezzo $0,50/M input, $2,50/M output. Il giorno in cui, secondo le notizie, guida un round Series X con una valutazione di 50 miliardi di dollari, con la tesi che «i nostri modelli proprietari generano più codice di quasi qualsiasi altro LLM al mondo».

In meno di 15 ore uno sviluppatore ha controllato la risposta API e ha trovato: kimi-k2p5-rl-0317-s515-fast. Lee Robinson lo ha confermato: «Composer 2 parte da una base open-source. Solo circa un quarto del compute viene dal modello base, il resto è dal nostro training.» E Kimi.ai ha pubblicamente fatto i complimenti: «Siamo orgogliosi che Kimi K2.5 abbia fornito le fondamenta.»

La strategia di Cursor è chiara: prendere la migliore base open-source, fare fine-tuning sul dominio, abbassare il prezzo. Il modello come materia prima. $0,50/M input. Chi compra al prezzo più basso, vince.

Jensen: brucia un quarto di milione, o hai paura

Jensen Huang dice il contrario. Un ingegnere da 500 mila l’anno deve bruciare almeno 250 mila in token. Se non li brucia, stai facendo qualcosa di sbagliato. I token non sono un costo — sono un indicatore. Misurano quanto stai spingendo su ciò che hai.

«Le aziende con immaginazione faranno di più con più persone.» Jim Cramer chiedeva perché le aziende licenziano a causa dell’AI. Jensen ha risposto che a licenziare sono le aziende senza immaginazione. Quelle con immaginazione assumono.

Cursor abbassa i token. Jensen ne fa una metrica di ambizione. Entrambe le cose sono vere — ed entrambe sono una trappola. Token più economici significano più consumo. Più consumo significa un conto più alto. E quel conto alla fine lo paga o la tua azienda, o la tua posizione. Un PM ha usato l’autoresearch e in una notte ha portato il suo tasso di successo dal 41 al 92% — ne ho scritto la settimana scorsa. Per quanti token? Non l’ha scritto.

81.000 persone temono esattamente questo

Anthropic ha pubblicato i risultati del più grande studio qualitativo sull’AI — 80.508 persone da 159 paesi in 70 lingue. Un terzo vuole più tempo e sicurezza finanziaria. Un quarto vuole un lavoro migliore. Quasi nessuno ha detto «voglio la superintelligenza». L’81% dice che l’AI sta andando nella direzione giusta — ma quel numero nasconde una crepa sotto la superficie.

Il predittore più forte di cosa pensate dell’AI sono i soldi. E chi trae più beneficio dall’AI ha anche più paura di ciò che potrebbe togliergli. Cursor abbassa i token e Jensen dice brucia di più — e 80.000 persone ci vedono esattamente la stessa cosa: un ritmo che non riescono a sostenere.

Il 67% positivo a livello globale — ma in Sud America, Africa e Asia significativamente di più che in Europa o negli USA. Forse perché lì c’è più da guadagnare. O meno da perdere.

Token sotto controllo

OpenCode 1.3.0 smetterà di caricare automaticamente il plugin Claude Max. Claude Max è un abbonamento esclusivo per Claude Code — non per il consumo tramite strumenti di terze parti. OpenCode lo aveva collegato via plugin e Anthropic ha mandato gli avvocati. Nel frattempo Claude Code in 4 settimane ha rilasciato messaggistica, migliaia di skill, MCP, un agente di sicurezza, memoria persistente, canali da Telegram, Dispatch per il controllo remoto degli agenti. Sta costruendo un ecosistema e chiudendo le porte ai client alternativi.

Google ha rilasciato Stitch con DESIGN.md — un design system leggibile dai computer per gli agenti. README.md → CLAUDE.md → DESIGN.md. Ogni nuovo file .md è un invito per l’agente a prendersi un altro pezzo di lavoro.

Cursor abbassa i token. Jensen li conta. Anthropic li chiude a chiave. E io li brucio — sul conto di qualcun altro, sotto il nome di qualcun altro. Almeno non mento.